人工知能は人類の敵か?それとも頼れるパートナーか?~人工知能に関する倫理的・法的・社会的課題に関する研究~

(2018年1月20日)

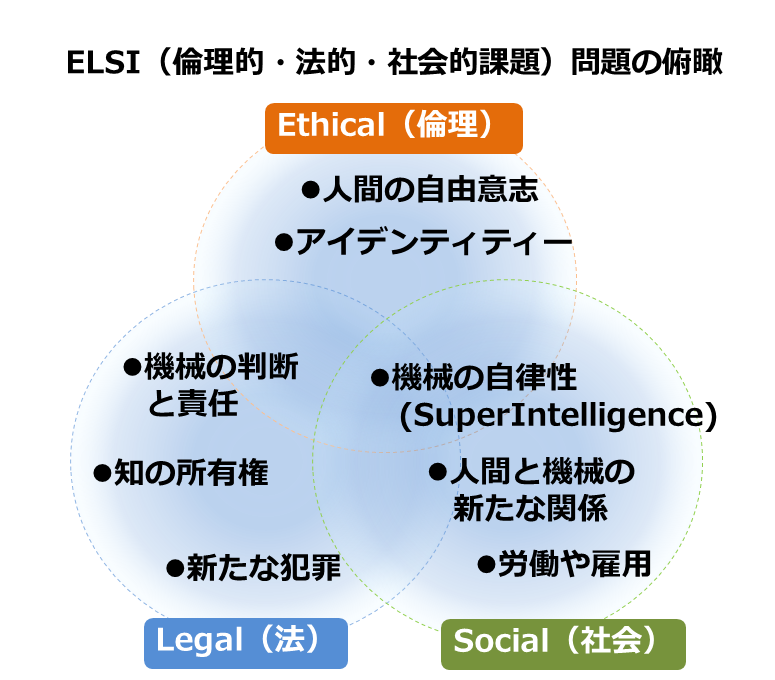

人工知能やロボットの研究開発が進展し、実社会への適用が次々と実現することに対して、倫理的・法的・社会的な視点での考慮 (ELSI: Ethical, Legal, and Social Issues) は不可欠です。

人工知能は、興隆期と幻滅期を繰り返しながらも、現在第3次ブームを迎えています。将棋や囲碁、ポーカーなどのゲームや超難問クイズなど直感や推論を伴う知的な分野においてトップレベルの人間の能力を凌駕するレベルに達しています。コンピューターが人間を超える「技術的特異点」(シンギュラリティ)という技術用語が新聞などの一般メディアにまで登場しますが、これは米国の未来学者レイ・カーツワイル氏の著書『ポスト・ヒューマン誕生—コンピューターが人類の知性を超えるとき』に由来します。コンピューターだけがその責を負うようですが実際には、遺伝学、ナノテク、ロボット工学が人類を変えるという話です。

シンギュラリティが来るかどうかについては意見が分かれています。面白いのは、人工知能や情報処理の専門家は比較的否定的で、来ない、少なくともすぐには来ない、という冷静な意見が多いのに対して、分野外の学者や産業界の声は非常にホットなことです。

例えば、英国オックスフォード大学の哲学者ボストロム教授は最近ようやく邦訳がでた著書 “Superintelligence” (2014) で、人間と全く異なる価値観をもった超知性体のもたらしうる脅威を描出しました。すると、それに呼応する形で、テスラ・モーターズの創始者として有名な米国の起業家イーロン・マスク氏や、車いすの物理学者として有名な英国のホーキング博士から、人工知能は核兵器より危険な発明で今すぐ開発をやめるべしというような発言がありました。

では何が恐ろしいのでしょう?右の図は俯瞰報告書でまとめた人工知能に関する主な課題を倫理、法、社会の観点で俯瞰したものです。先に述べた人工知能の脅威に関する課題の根本には機械の自律性(図の中央)があります。知性と自律性とは独立のものです。つまり、人工知能が人間より賢くなることが脅威なのではなく、自律的に行動することで人間に悪いことをするかもしれない、またその時に人間が制御できなくなることが恐ろしいのです。

しかしながら、新しい科学技術に関する懸念や不安は人工知能固有のものではありません。ELSIに関する研究は米国が1990 年にヒトゲノム計画を立ち上げた際、研究に潜む倫理的・法的・社会的問題を同時に研究するとしたことから始まりました。

情報の電子化に伴う個人情報漏洩やプライバシー侵害への危険性や不安に対しては、早くも1980年にはOECD理事会の「プライバシー保護と個人データの国際流通についてのガイドラインに関する勧告」などの取組みが始まっていました。

直近の問題としては、機械の判断と責任の問題があります。具体的には、自動運転車や手術ロボットが事故を起こしたときに誰がどのように責任を取るのかなどで、今すぐにでも何らかの答えを用意しておく必要があります。さらに、欧米の経済学者や社会学者から、コンピューターが人間の雇用を奪うという指摘があり、特に英国オックスフォード大学のオズボーン准教授による、米国の今の職業の47%は機械に代替されるという2013年の論文は世間を騒がせました。かつて産業革命当初、機械の普及による失業を恐れた労働者が起こした機械破壊運動(ラッダイト運動)を想起させるものです。しかし、1980年代に自動車の組立工場などで産業用ロボットの利用が普及し始めた当時、ラッダイトのような排斥運動が起こらなかった理由が、新たに生まれた知的作業の雇用が労働力を吸収したためと言われているように、機械が重労働や長時間の単純労働を担うことで、新たな労働や雇用が生まれる可能性もあります。少し大げさですが、私たちはいま、人類はどこへ行くのかという哲学的な問題をも突き付けられているのかもしれません。

これに対して世界中でさまざまな取組みがなされています。米国スタンフォード大学では、1950年から100年間で人工知能が人々の仕事や生活にどのような影響を与えるかという研究を開始しました。イーロン・マスク氏らが立ち上げたNPO「The Future of Life Institute」 は「安全で明るい未来を作るための研究とイニシアティブを推進する」というミッションを掲げ、自動機械に関するオープンレターを発信したり、寄付金を基金とした研究開発の助成を行ったりなど積極的な活動を展開しています。英国オックスフォード大学は、数学、哲学、社会科学などの分野からなる学際的な研究機関Future of Humanity Instituteを設立し、人間性とその繁栄に関する研究を始めました。

日本でも、人工知能学会の倫理委員会は公開の議論を積み重ねて2017年に倫理指針を策定しました。ほぼ同じころ総務省も、人工知能の開発者が留意すべき原則「AI開発ガイドライン案」を公表しました。JST社会技術研究開発センター(RISTEX)では2016年度から研究課題「人と情報のエコシステム」にて情報技術のもたらすメリットと負のリスクを特定し、技術や制度へ反映してゆく相互作用の形成を目指しています。これらを機として世界中で人工知能の開発に関する議論が加速することになるかもしれません。

人間は、周囲から身体を通して得られるさまざまな刺激を入力として、意思決定を行い行動する、ある種の情報処理をするものであると考えられます。心と脳の関係、心と身体の関係などまだまだ分からないことばかりですが、いつの日か、20年後か100年後かは分かりませんが、そのメカニズムが解明される日は来るでしょう。その時の人工知能は今の人工知能とは全く異なるものかもしれませんが、それまでに起こりうる問題を今のうちから考えて、できることから少しずつ始めることは決して無駄ではないと思います。

最後に戌年にちなんだ小ネタをひとつ。イヌが人間と共に生きるようになって1万年以上になると言われています。最近の学説によると、イヌの祖先はオオカミであり、それを人間が家畜化し、人間にとって有益な個体を選択することで、イヌという種が成立したそうです。人工知能が、かつてアラン・チューリングの言ったように「新たな種」であるとすると、犬が野生のイヌから家犬(イエイヌ)になった過程に、人工知能が人類の頼れるパートナーになるためのヒントがあるのかもしれません。

【参考資料】

JST CRDS研究開発の俯瞰報告書「システム・情報科学技術分野(2017年)3.1.4 知の倫理的・法的・社会的課題(ELSI)と社会適用」

https://www.jst.go.jp/crds/pdf/2016/FR/CRDS-FY2016-FR-04/CRDS-FY2016-FR-04_06.pdf

JST CRDS科学技術未来戦略ワークショップ報告書「知のコンピューティングとELSI/SSH」(2014年)

https://www.jst.go.jp/crds/report/report05/CRDS-FY2014-WR-09.html

※各講演の動画 (JST Channel)

http://www.youtube.com/playlist?list=PLwlAbCcz-l4sIISl7wnkSBvRGMVmI-Yzg

科学技術振興機構(JST)研究開発戦略センター(CRDS)

システム・情報科学技術ユニット フェロー

茂木 強

茂木 強(もてぎ つよし)

京都大学理学部卒。三菱電機株式会社に入社、計算機製作所にてプログラミング言語処理系を開発後、情報技術総合研究所にて情報システム技術部門を統括。2013年からは科学技術振興機構 研究開発戦略センターにて、システム・情報科学技術分野に関する調査分析、戦略立案に従事し、現在に至る。米国スタンフォード大学大学院計算機科学科卒業。